激活函数是神经网络中神经元的一部分,负责将输入映射到输出,引入非线性以帮助网络学习复杂模式。本文介绍了深度学习中常见的激活函数,并提供了可视化图像及相关数学表达。

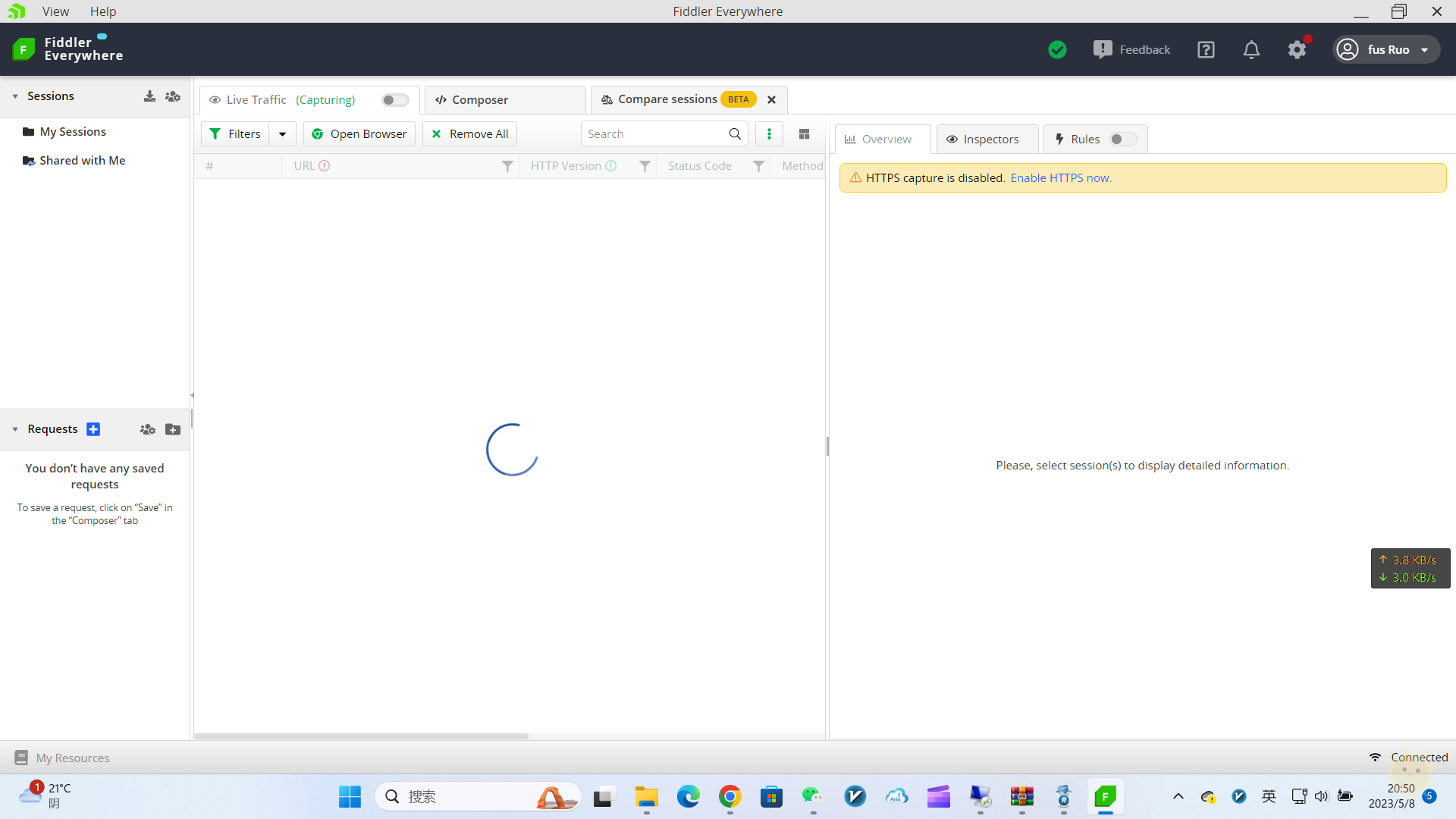

![图片[1]-Python可视化神经网络中常见的激活函数-山海云端论坛](https://www.shserve.cn/wp-content/uploads/2024/04/20240409200132407-image.png)

线性函数

线性激活函数定义了输入和输出之间的线性关系,最简单形式为 𝑦=𝑥 y=x。其可视化图像如下:

![图片[2]-Python可视化神经网络中常见的激活函数-山海云端论坛](https://www.shserve.cn/wp-content/uploads/2024/04/20240409200248387-380052dad9b3482872c038d48ecf7a83-1024x256.jpg)

单位阶跃函数

单位阶跃函数的数学表达为 [图片]。注意该函数不连续,其可视化图像如下:

![图片[3]-Python可视化神经网络中常见的激活函数-山海云端论坛](https://www.shserve.cn/wp-content/uploads/2024/04/20240409200328773-febead1cce790332c79b98de82acd59a-1024x256.jpg)

Sigmoid 函数

Sigmoid 函数是一种常见的 S 函数,其数学定义为

![图片[4]-Python可视化神经网络中常见的激活函数-山海云端论坛](https://www.shserve.cn/wp-content/uploads/2024/04/20240409200920310-dfbf48deefb71cd42e4aae700048cd83.png)

可视化图像如下:

![图片[5]-Python可视化神经网络中常见的激活函数-山海云端论坛](https://www.shserve.cn/wp-content/uploads/2024/04/20240409201059664-e405b3335356250094489d64c9d45d29-1024x256.jpg)

tanh 双曲正切函数

双曲正切函数是另一种 S 形激活函数,其定义为

![图片[6]-Python可视化神经网络中常见的激活函数-山海云端论坛](https://www.shserve.cn/wp-content/uploads/2024/04/20240409201112415-0217f04caabe242a69a2303d9b01708e.png)

可视化图像如下:

![图片[7]-Python可视化神经网络中常见的激活函数-山海云端论坛](https://www.shserve.cn/wp-content/uploads/2024/04/20240409201121859-933bc04323384d526f1e46ced11f32b4-1024x256.jpg)

SoftSign 函数

SoftSign 是 Tanh 函数的替代选择,其数学定义为

![图片[8]-Python可视化神经网络中常见的激活函数-山海云端论坛](https://www.shserve.cn/wp-content/uploads/2024/04/20240409201134440-9699e8ea479ac215b24238257a75020e.png)

对应的可视化图像如下:

![图片[9]-Python可视化神经网络中常见的激活函数-山海云端论坛](https://www.shserve.cn/wp-content/uploads/2024/04/20240409201143445-5a1e1ed640dfb6e426b43bb4fd595b05-1024x256.jpg)

ReLU 函数

ReLU 函数在深度学习中广泛应用,其数学定义为

![图片[10]-Python可视化神经网络中常见的激活函数-山海云端论坛](https://www.shserve.cn/wp-content/uploads/2024/04/20240409201157376-53c6bbdfa4d7234897d9eec5204c5117.png)

可视化图像如下:

![图片[11]-Python可视化神经网络中常见的激活函数-山海云端论坛](https://www.shserve.cn/wp-content/uploads/2024/04/20240409201204142-b032139076e422eb238f20b9a1dcd772-1024x256.jpg)

PReLU 函数

PReLU 是对 ReLU 的改进版本,其定义为

![图片[12]-Python可视化神经网络中常见的激活函数-山海云端论坛](https://www.shserve.cn/wp-content/uploads/2024/04/20240409201216837-dca59a639d19fc7854ac78b3b4a99f80.png)

可视化图像如下:

![图片[13]-Python可视化神经网络中常见的激活函数-山海云端论坛](https://www.shserve.cn/wp-content/uploads/2024/04/20240409201225989-d80ec6dcc5939d17aa2259e0583b23ab-1024x256.jpg)

ELU 函数

ELU 函数扩展了 ReLU,其定义为

![图片[14]-Python可视化神经网络中常见的激活函数-山海云端论坛](https://www.shserve.cn/wp-content/uploads/2024/04/20240409201241830-36717df3615a34a2f6fa96e946a97c8f.png)

可视化图像如下:

![图片[15]-Python可视化神经网络中常见的激活函数-山海云端论坛](https://www.shserve.cn/wp-content/uploads/2024/04/20240409201252472-d2972ee0bbf4c4dbab3f6eaeca0dbc13-1024x256.jpg)

SoftPlus 函数

SoftPlus 函数的定义为

![图片[16]-Python可视化神经网络中常见的激活函数-山海云端论坛](https://www.shserve.cn/wp-content/uploads/2024/04/20240409201301464-b786e9b5decf21314f6176e5a8b74136.png)

可视化图像如下:

![图片[17]-Python可视化神经网络中常见的激活函数-山海云端论坛](https://www.shserve.cn/wp-content/uploads/2024/04/20240409201310914-d1695889390bf766a443d5bf697b07a3-1024x256.jpg)

总结

本文总结了深度学习中常见的激活函数,并提供了函数及导函数的可视化图像,以及完整的代码示例。

© 版权声明

THE END

![表情[qiudale]-山海云端论坛](https://www.shserve.cn/wp-content/themes/Shanhai/img/smilies/qiudale.gif) 我也是买了领不了、

我也是买了领不了、

暂无评论内容